📑 목차

선정 이유: AI 데이터센터 전기 효율 극대화 분석의 필요성

GPT-4 학습에 소요된 전력량이 약 50~60GWh에 달한다는 추정이 나옵니다. 이는 미국 전체 가정 5만여 가구가 하루 동안 사용하는 전력에 해당하는 규모죠. 문제는 이러한 전력 소모가 일회성이 아니라는 점입니다. 추론(Inference) 단계에서의 전력 사용량이 학습보다 수십 배 높을 수 있다는 연구 결과도 속속 제기되고 있습니다.

데이터센터는 이미 지구 온난화에 기여하는 탄소 배출원 중 하나로 지목받고 있습니다. 국제에너지기구(IEA)에 따르면 2022년 전 세계 데이터센터의 전력 소비량은 전체의 1~1.3%를 차지했으며, AI 워크로드 증가로 2026년까지 두 배에 가까운 증가가 예측됩니다. 단순히 전기세 절감을 넘어, 기업의 ESG 평가와 정부 규제 강화라는 생존의 문제로 다가왔습니다.

그런데 여기서 멈추면 안 됩니다. 전력 사용량을 줄이는 것과 동시에 연산 능력을 유지하거나 오히려 높여야 한다는 역설적인 과제가 존재합니다. 바로 이 지점에서 최신 기술들이 등장하고 있습니다.

PUE 1.0 시대를 여는 냉각 기술 혁신

전통적인 공기 냉각(Air Cooling) 방식은 한계에 도달했습니다. AI GPU의 열 설계 전력(TDP)이 700W를 넘어서면서 기존 팬과 에어컨 조합으로는 식열이 불가능해진 것이죠.

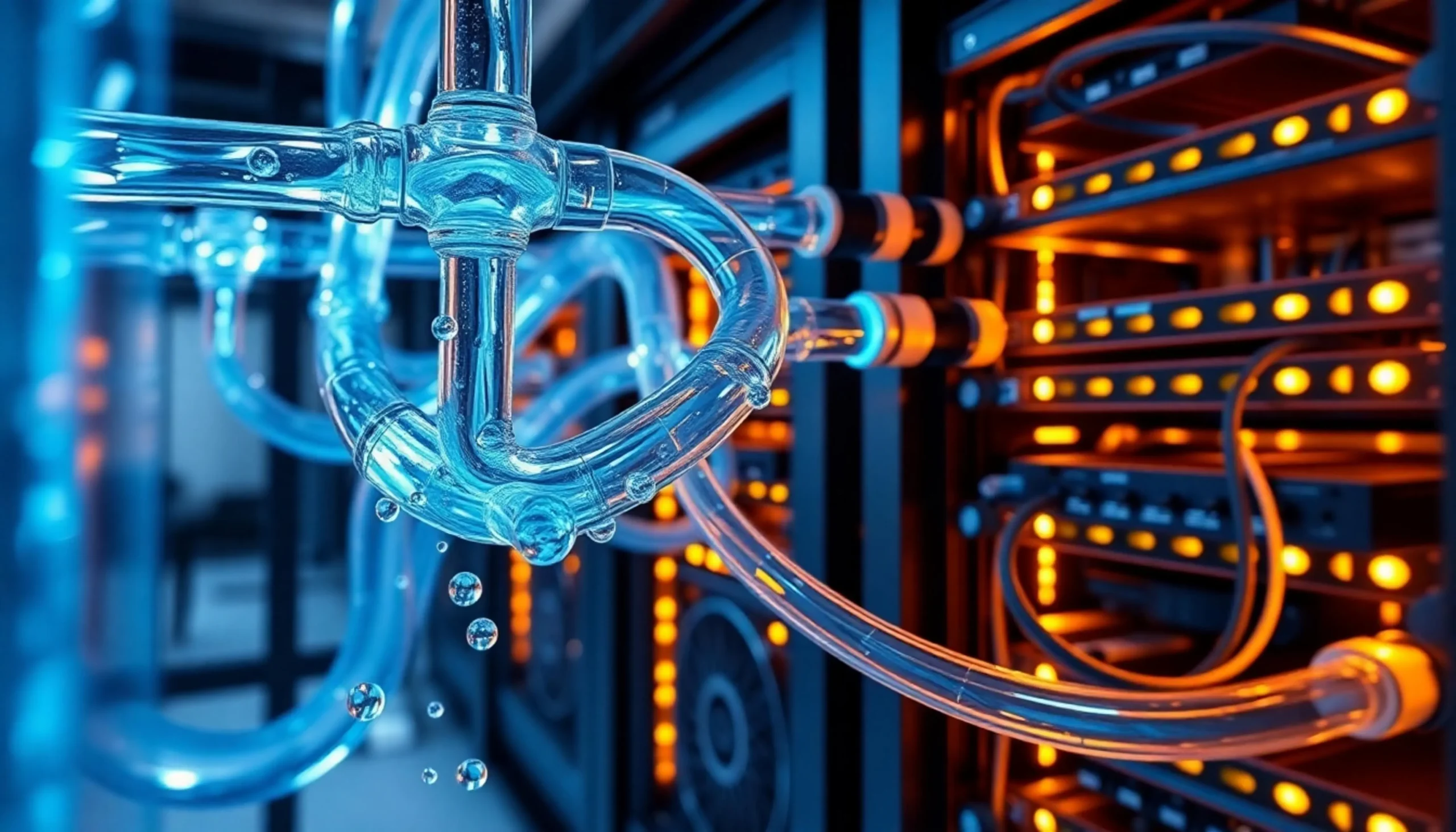

리퀴드 쿨링의 상용화 가속

직접 액체 냉각(Direct Liquid Cooling, DLC)과 이머전 쿨링(Immersion Cooling)이 대안으로 떠올랐습니다. 전자는 CPU/GPU 등 발열 부품에 콜드 플레이트를 직접 장착하여 냉각수가 열을 빨아들이는 방식이며, 후자는 서버 전체를 불활성 냉매에 담그는 극단적인 접근입니다.

이머전 쿨링은 PUE(Power Usage Effectiveness, 전력 사용 효율)를 1.03 수준까지 낮출 수 있습니다. 공기보다 1,000배 이상 높은 열 전도율을 가진 액체의 물리적 특성을 활용하는 것입니다. 마이크로소프트는 해저 데이터센터 프로젝트를 통해 자연 해수 냉각의 가능성을 검증했고, 현재는 폐쇄 루프 시스템에서도 같은 효율을 구현하려 하고 있습니다.

| 냉각 방식 | PUE 목표 | 초기 도입 비용 | 유지보수 복잡도 | 적합한 워크로드 |

|---|---|---|---|---|

| 공랭식 (전통) | 1.4~1.6 | 낮음 | 낮음 | 일반 서버 |

| 냉수식 (Chilled Water) | 1.2~1.3 | 중간 | 중간 | 고밀도 랙 |

| 리퀴드 쿨링 (DLC) | 1.05~1.15 | 높음 | 높음 | AI/HPC 서버 |

| 이머전 쿨링 | 1.02~1.08 | 매우 높음 | 매우 높음 | 초고밀도 AI 클러스터 |

표를 보면 알 수 있듯, 효율이 높아질수록 복잡도는 기하급수적으로 증가합니다. 따라서 데이터센터 설계 단계부터 냉각 방식을 결정하지 않으면, 기존 시설을 개조하는 비용이 새로 짓는 것보다 비쌀 수 있습니다.

AI 반도체 자체의 전력 최적화 설계

냉각만으로는 부족합니다. 칩 자체에서 발생하는 열을 줄이는 것, 즉 ‘전력 효율 per Watt’를 높이는 아키텍처 설계가 핵심입니다.

칩렛(Chiplet) 아키텍처와 전력 관리

모놀리식(단일 다이) 설계에서 칩렛 방식으로 전환하면 특정 연산 유닛만 선택적으로 전원을 공급하거나 차단할 수 있습니다. AMD의 MI300 시리즈나 인텔의 Gaudi3이 대표적인 예시입니다. 메모리와 연산 유닛을 물리적으로 가까이 배치하는 3D 스태킹 기술도 데이터 이동으로 인한 전력 손실을 줄입니다.

또한 저전력 AI 추론 칩의 등장도 주목할 만합니다. 엔비디아의 Jetson 시리즈나 구글의 Edge TPU는 데이터센터급 성능은 아니지만, 엣지에서 처리할 수 있는 워크로드를 중앙 서버로 보내지 않음으로써 막대한 백홀 전력을 절감하는 효과를 냅니다. 실제로 자율주행차나 스마트 공장에서 생성되는 데이터의 70% 이상을 엣지에서 선처리한다면, 데이터센터의 부하를 획기적으로 낮출 수 있습니다.

24/7 재생에너지 매칭과 차세대 저장 시스템

효율을 높였다면, 이제 전원 자체를 깨끗하게 만드는 문제로 넘어갑니다. 태양광과 풍력은 간헐성 문제가 있습니다. 데이터센터가 24시간 가동되는 특성상 이를 해결해야 합니다.

수소 연료전지와 대규모 ESS

구글과 마이크로소프트는 ’24/7 무탄소 에너지 매칭’을 선언했습니다. 이는 연간 평균이 아닌 매 시간마다 사용하는 전력이 재생에너지에서 나와야 한다는 의미입니다. 이를 위해 대용량 배터리(ESS)와 수소 연료전지를 결합한 하이브리드 저장 시스템을 도입하고 있습니다.

수소는 장기 저장에 유리합니다. 여름철 과잉 생산된 태양광 전력으로 수소를 생산해 저장했다가, 겨울철 풍력이 부족할 때 연료전지로 전환하는 방식입니다. 현대차그룹이 천안 데이터센터에 도입한 수소 연료전지 시스템은 1MW급으로 시작해 2030년까지 100% 수소 전환을 목표로 하고 있습니다.

폐열 순환 경제와 지역 에너지 생태계

데이터센터가 내뿜는 열은 단순히 버려야 할 쓰레기가 아닙니다.北유럽의 경우 데이터센터 폐열을 지역난방에 활용하는 사례가 보편화되었습니다. 덴마크의 Facebook(현 Meta) 오덴세 데이터센터는 주변 지역 6,900가구의 난방을 책임지고 있습니다.

수경재배와 산업 공정 열원

AI 데이터센터의 폐열 온도는 일반적으로 60~80℃로, 스마트팜의 수경재배나 수산물 양식에 최적입니다. 네이버의 세종 데이터센터 ‘각’은 폐열을 활용한 스마트팜을 연계해 1년 내내 딸기를 생산하고 있습니다. 이러한 ‘산학 연계’ 모델은 데이터센터의 사회적 인허가(License to Operate)를 얻는 데도 큰 도움이 됩니다.

열 재활용의 경제성도 개선되고 있습니다. 과거에는 폐열을 30km 이상 운송하면 에너지 손실이 커져 비효율적이었으나, 현대의 초절연 배관 기술로 10km 이상도 손실 없이 운반 가능해졌습니다. 데이터센터 입지 선정 시 반드시 주변 지역의 열 수요를 고려해야 하는 시대가 온 것입니다.

자주 묻는 질문

Q. PUE 1.0은 현실적으로 달성 가능한가요?

A. 이론적으로는 가능하지만, 현실적으로는 1.0에 가까워지는 것이 목표입니다. PUE 1.0은 냉각이나 전력 변환, 백업 시스템을 전혀 사용하지 않는다는 의미이므로 물리적으로 불가능합니다. 현재 최첨단 데이터센터는 1.05~1.1 수준을 목표로 하며, 이는 이머전 쿨링과 재생에너지 직접 연계를 통해 달성됩니다.

Q. 기존 공랭식 데이터센터를 리퀴드 쿨링으로 개조하는 비용은 어느 정도인가요?

A. 단순 냉각 장치 교체를 넘어, 바닥 하중 증가, 누수 방지 설비, 전력 인프라 변경 등이 필요해 랙당 2~5백만 원 이상의 추가 비용이 발생할 수 있습니다. 따라서 잔여 수명이 5년 이상인 시설이 아니라면, 새로운 시설을 짓는 것이 더 경제적일 수 있습니다. 다만, AI GPU 도입을 위해 반드시 필요하다면 단계적 하이브리드 방식을 고려할 수 있습니다.

Q. AI 칩의 전력 소모량은 향후 어떻게 변화할 것인가요?

A. 단순 증가만은 아닙니다. 2025년부터는 ‘전력 당 연산량(OPS/Watt)’이 칩 설계의 핵심 KPI가 되고 있습니다. 엔비디아의 차세대 루빈 아키텍처나 인텔의 팰콘 쇼어는 동일 성능 대비 전력을 30~40% 낮추는 것을 목표로 하고 있습니다. 다만, AI 모델의 규모 자체가 기하급수적으로 커지므로, 전체 데이터센터 소비 전력은 계속 증가할 전망입니다. 효율화는 증가 속도를 늦추는 역할을 하게 됩니다.